Bygning af sikre AI – drevne systemer : En omfattende guide

Building secure ai-powered systems er afgørende i en verden, hvor kunstig intelligens (AI) bliver mere og mere udbredt. Sikkerhed i AI-systemer handler ikke kun om at beskytte data, men også om at sikre systemernes pålidelighed og robusthed mod manipulation og angreb.

Hvorfor er det vigtigt at bygge sikre AI-drevne systemer?

AI-systemer bruges i dag i mange kritiske applikationer, fra sundhedsvæsen og finans til transport og national sikkerhed. Kompromitterede AI-systemer kan have alvorlige konsekvenser, herunder:

- Finansielle tab: Svindel og tyveri gennem manipulerede AI-systemer.

- Skade på omdømme: Tab af tillid til organisationer, der anvender usikre AI-løsninger.

- Sikkerhedsrisici: AI-styrede systemer, der bruges i kritisk infrastruktur, kan blive angrebet.

- Brud på privatlivets fred: Kompromittering af persondata, der behandles af AI-systemer.

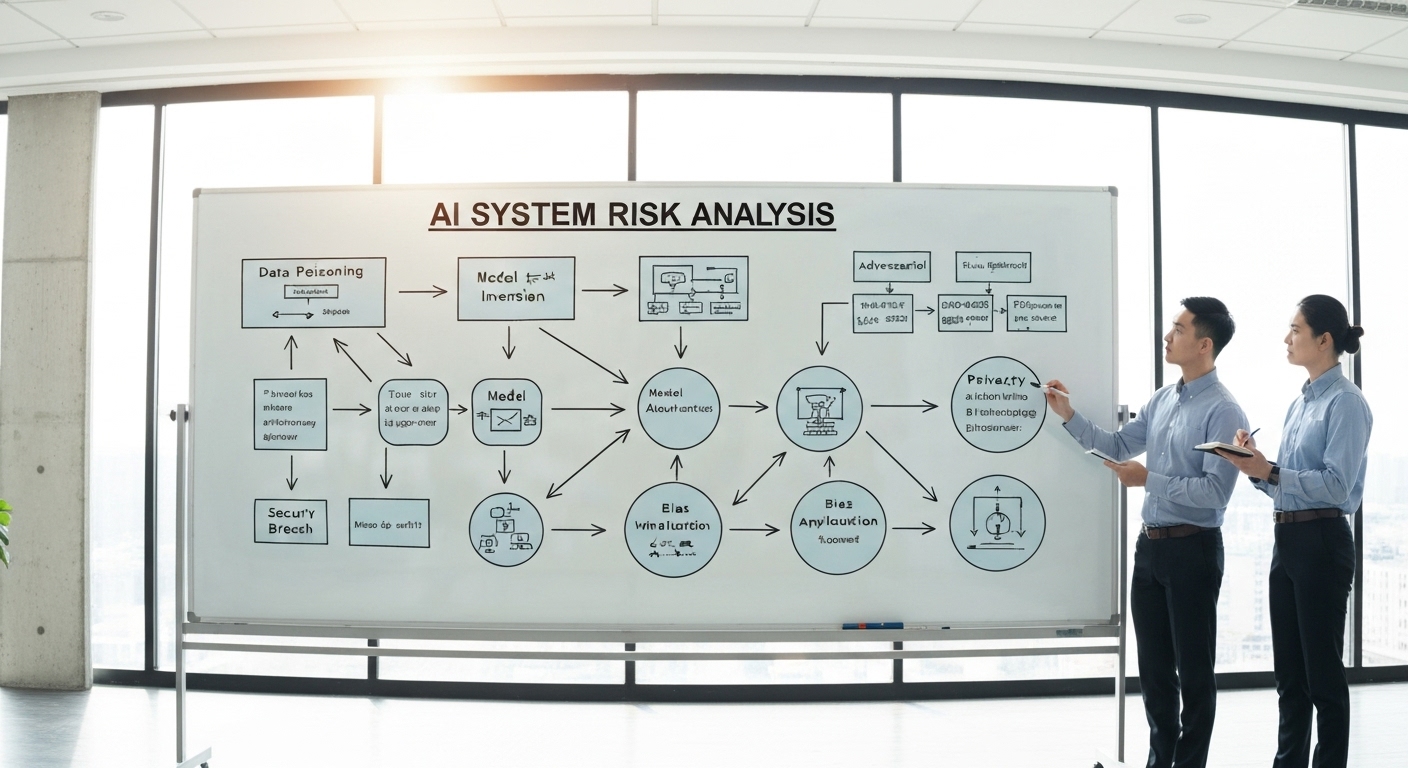

Risikoanalyse og trusselsmodellering for AI-systemer

En grundig risikoanalyse er det første skridt i at bygge sikre AI-systemer. Dette indebærer at identificere potentielle sårbarheder, trusler og de potentielle konsekvenser af disse. Trusselsmodellering hjælper med at forstå, hvordan angribere kan forsøge at udnytte disse sårbarheder. Det er vigtigt at overveje både traditionelle it-sikkerhedstrusler og AI-specifikke trusler som:

- Adversarial attacks: Manipulation af inputdata for at få AI-systemet til at træffe forkerte beslutninger.

- Data poisoning: Forurening af træningsdata for at kompromittere AI-modellens nøjagtighed.

- Model inversion: Forsøg på at udtrække følsomme oplysninger fra AI-modellen.

Nøgleprincipper for sikkert AI-design

Sikkert AI-design bør integreres i alle faser af udviklingsprocessen. Her er nogle nøgleprincipper:

- Security by design: Indbyg sikkerhed i systemet fra starten, i stedet for at tilføje det som en eftertanke.

- Defense in depth: Implementer flere lag af sikkerhed for at beskytte mod en bred vifte af trusler.

- Least privilege: Giv kun brugere og systemer de nødvendige adgangsrettigheder.

- Regular monitoring and auditing: Overvåg systemet løbende for at opdage og reagere på sikkerhedshændelser.

- Robustness: Design AI-systemer, der kan modstå uventede input og modstanderangreb.

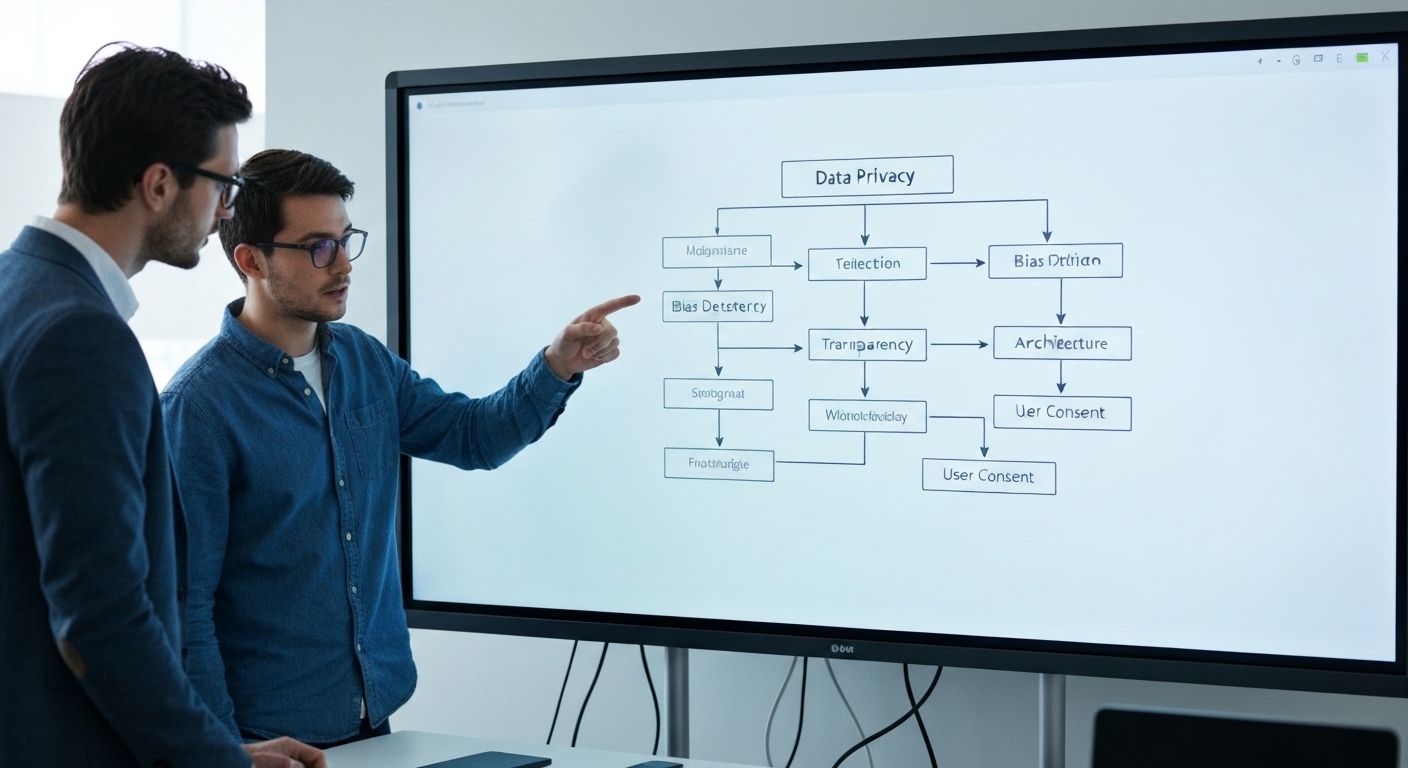

Datasikkerhed og privatlivsbeskyttelse i AI

Datasikkerhed er en kritisk komponent i building secure ai-powered systems. AI-systemer behandler ofte store mængder data, herunder følsomme persondata. Det er vigtigt at implementere stærke databeskyttelsesforanstaltninger, såsom:

- Data kryptering: Krypter data i hvile og under transport.

- Adgangskontrol: Begræns adgangen til data baseret på behovet for at vide.

- Anonymisering og pseudonymisering: Fjern eller erstat identificerende oplysninger fra data.

- Overholdelse af databeskyttelseslovgivning: Sikre overholdelse af GDPR og andre relevante databeskyttelseslove.

Et link til mere information om cloud-løsninger kan findes på flashs.cloud.

Sikkerhed under træning af AI-modeller

Træningsdata skal sikres for at forhindre data poisoning-angreb. Dette kan opnås gennem:

- Data validering: Kontroller data for nøjagtighed og konsistens.

- Data rensning: Fjernelse af støj og fejl fra data.

- Adversarial training: Træning af AI-modellen til at modstå adversarial attacks.

Implementering af sikkerhedskontrol i AI-systemer

Der findes en række sikkerhedskontroller, der kan implementeres for at beskytte AI-systemer, herunder:

- Firewalls og intrusion detection systems (IDS): Beskyt mod uautoriseret adgang til systemet.

- Sikkerhedsscanning og sårbarhedsvurdering: Identificer og ret sårbarheder i systemet.

- Logning og overvågning: Overvåg systemaktivitet for at opdage sikkerhedshændelser.

- Incident response plan: Udvikl en plan for at reagere på sikkerhedshændelser.

Sikkerhedstest af AI-systemer

Regelmæssig sikkerhedstest er afgørende for at identificere og rette sårbarheder i AI-systemer. Dette kan omfatte:

- Penetreringstest: Simulering af et angreb for at teste systemets sikkerhed.

- Fuzzing: Test af systemet med tilfældige eller uventede input for at finde fejl.

- Kode gennemgang: Manuel gennemgang af koden for at identificere sårbarheder.

Overvågning og vedligeholdelse af sikre AI-systemer

Sikkerhed er en løbende proces. Det er vigtigt at overvåge AI-systemer løbende for at opdage og reagere på sikkerhedshændelser. Dette kan omfatte:

- Loganalyse: Gennemgang af logfiler for at identificere mistænkelig aktivitet.

- Performance overvågning: Overvågning af systemets ydeevne for at opdage anomalier.

- Regelmæssige sikkerhedsopdateringer: Installation af de seneste sikkerhedsopdateringer for at rette sårbarheder.

Etisk AI og ansvarlig udvikling

Ud over sikkerhed er det også vigtigt at overveje de etiske aspekter af AI. AI-systemer kan have betydelige sociale og økonomiske konsekvenser, og det er vigtigt at sikre, at de udvikles og anvendes på en ansvarlig måde. Dette omfatter:

- Fairness og bias: Sikre, at AI-systemer ikke er biased mod bestemte grupper.

- Transparency og explainability: Gøre det muligt at forstå, hvordan AI-systemer træffer beslutninger.

- Accountability: Fastlægge ansvar for de beslutninger, der træffes af AI-systemer.

Implementering af robusthed i AI-systemer

Robusthed henviser til et AI-systems evne til at opretholde sin præstationsevne under ugunstige forhold, såsom støjende data eller modstanderangreb. For at øge robustheden i AI-systemer kan man implementere følgende:

- Adversarial training: Træning af modellen til at modstå specifikke typer af angreb.

- Input validering: Kontrol af inputdata for at sikre, at de er inden for forventede grænser.

- Ensemble metoder: Brug af flere AI-modeller i kombination for at forbedre nøjagtigheden og robustheden.

Integration med eksisterende systemer

Når man integrerer AI-systemer med eksisterende it-infrastruktur, er det vigtigt at overveje sikkerheden. Dette kan involvere:

- API sikkerhed: Sikring af API’er, der bruges til at kommunikere mellem AI-systemet og andre systemer.

- Adgangskontrol: Begrænsning af adgangen til AI-systemet fra andre systemer.

- Data isolation: Adskillelse af data, der behandles af AI-systemet, fra andre data.

Eksempel på en sikringsstrategi

Lad os forestille os, at vi bygger et AI-drevet system til at detektere svindel i finansielle transaktioner. En sikringsstrategi kunne omfatte:

- Risikoanalyse: Identifikation af potentielle trusler, såsom data poisoning og adversarial attacks.

- Sikkert design: Implementering af security by design principper, såsom defense in depth og least privilege.

- Datasikkerhed: Kryptering af data i hvile og under transport, samt implementering af adgangskontrol.

- Sikkerhedstest: Regelmæssig penetreringstest og fuzzing for at identificere sårbarheder.

- Overvågning: Løbende overvågning af systemaktivitet for at opdage sikkerhedshændelser.

- Etisk AI: Sikring af, at systemet ikke er biased mod bestemte grupper og at beslutningerne er transparente og forklarbare.

Konklusion

Building secure ai-powered systems er en kompleks og udfordrende opgave, men det er afgørende for at sikre, at AI-systemer anvendes på en sikker, pålidelig og ansvarlig måde. Ved at følge de principper og praksisser, der er beskrevet i denne artikel, kan du reducere risikoen for sikkerhedshændelser og sikre, at dine AI-systemer fungerer som forventet. Husk at sikkerhed er en løbende proces, og det er vigtigt at overvåge og vedligeholde dine AI-systemer løbende for at imødegå nye trusler. For yderligere læsning, se NIST.

HOTLINE

+84372 005 899